Amenaza de extinción si no se restringe desarrollo de IA: informe Gobierno EU

Dos categorías de riesgo: uso de Inteligencia Artificial para "catastróficos ataques" biológicos, químicos o cibernéticos; y pérdida de control de la IA

Esta actualización es enviada por adelantado a nuestros suscriptores de pago, como agradecimiento por su patrocinio, el jueves a las 19 horas. A las 07 horas del viernes, se abrirá el acceso al público en general.

MundoAbierto.info es una publicación con el respaldo de su comunidad. Para recibir nuevos posts y apoyar nuestro trabajo, considera convertirte en un suscriptor gratis o de pago.

"El auge de la Inteligencia Artificial (IA) y de la Inteligencia Artificial General (IAG) avanzadas tiene el potencial de desestabilizar la seguridad global de maneras que recuerdan a la introducción de armas nucleares", señala un informe comisionado por el Departamento de Estado estadounidense, que alerta de que, en el peor de los escenarios proyectados, estas tecnologías podrían convertirse en una “amenaza a nivel de extinción para la especie humana”.

Investigadores de la empresa contratada, Gladstone AI, pasaron más de un año realizando entrevistas con más de 200 expertos y trabajadores del gobierno y de compañías de IA de vanguardia, para elaborar el documento dado a conocer este lunes bajo el título “Defensa en profundidad: Un plan de acción para aumentar la seguridad de la IA avanzada”.

En él, identifican dos tipos de amenazas. El primero es el “riesgo de que las conviertan en armamento” (weaponization), ya que “tales sistemas podrían usarse potencialmente para diseñar e incluso ejecutar ataques biológicos, químicos o cibernéticos catastróficos, o permitir aplicaciones como armas sin precedentes en robótica de enjambre”.

El segundo es el riesgo de “pérdida de control”, es decir, que los sistemas avanzados de inteligencia artificial superen a sus creadores, pues hay “razones para creer que pueden ser incontrolables si se desarrollan utilizando las técnicas actuales, y podrían comportarse de forma adversa a los seres humanos”.

Ambas categorías se hacen más serias cuando se considera el nivel de competencia que prevalecen entre las firmas más agresivas de las que trabajan en el área.

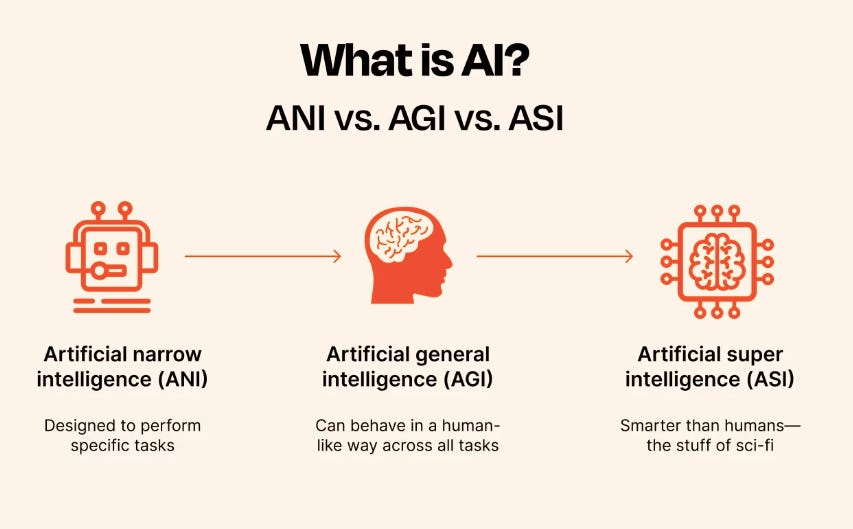

La Inteligencia Artificial es entendida en tres niveles de desarrollo. Nos encontramos en el inicial, la Inteligencia Artificial Estrecha, diseñada para llevar a cabo tareas específicas. Por más que nos parezcan sorprendentes, los modelos de lenguaje como ChatGPT, Bard y todos los demás están en este rango.

Después seguirá la Inteligencia Artificial General, cuyo nivel de desempeño será igual o mayor que el humano, antes de llegar a la Súper Inteligencia Artificial, que será más brillante que nuestra especie y, según algunos, podría alcanzar algún tipo de conciencia.

La IAG aún es una tecnología hipotética pero el informe prevé que será desarrollada dentro de alrededor de cinco años. La primera empresa en alcanzarla quedará en posición para mantener un liderazgo y quedarse con los beneficios, lo que representa una enorme motivación para que las compañías dejen a la seguridad en un lugar secundario frente a la velocidad.

"Los laboratorios de inteligencia artificial de vanguardia enfrentan un incentivo intenso e inmediato para escalar sus sistemas de inteligencia artificial lo más rápido que puedan", señala el reporte, mientras que, por el otro lado, "no tienen un incentivo inmediato para invertir en seguridad o medidas de protección que no generan beneficios económicos directos, aunque algunos lo hacen por genuina preocupación".

Entre los entrevistados, muchos trabajadores de seguridad de los laboratorios compartieron su preocupación por los “incentivos perversos” que animan a los ejecutivos de sus empresas.

Restricciones anti-proliferación

Sobre estas advertencias, toman forma las recomendaciones del “plan de acción” propuesto por Gladstone IA, que incluye un conjunto de acciones y políticas públicas sin precedentes que, de implementarse, alterarían radicalmente la industria de la IA.

El Congreso de .EU. declararía ilegal el entrenamiento de modelos de IA por encima de cierto estándar de potencia informática, que sería fijado por una nueva agencia federal especializada, posiblemente justo por encima de los niveles utilizados para los actuales modelos de vanguardia, como el GPT-4.

Las autoridades prohibirían la publicación de los “pesos” (weights o datos de funcionamiento interno) de los modelos más potentes bajo licencias de código abierto, con castigos tan severos como penas de cárcel.

Ya que en el hardware hay varios cuellos de botella para estas tecnologías, especialmente en los chips de punta, se reforzarían los controles de su fabricación y exportación. También se destinarían fondos a investigaciones de “alineación” de la IA, para garantizar que sea más segura.

Todo esto, dice el informe, “podría moderar la dinámica de competencia de los desarrolladores” y eventualmente, tras las suficientes comprobaciones de seguridad, la agencia de IA podría elevar el umbral de uso de potencia informática para entrenar sistemas más avanzados, o al revés, bajarlo si se descubren capacidades peligrosas en los ya existentes.

Y como es previsible que el desarrollo de los algoritmos haga descender la potencia mínima requerida, se podría considerar impedir la publicación de investigaciones que mejoren la eficiencia algorítmica.

Esto último, reconoce el documento, podría dañar a la industria y además ser imposible de realizar. Igualmente, una regulación excesiva podría dañar a las empresas estadounidenses en favor de las de otros países competidores.

Para elaborar su evaluación, los investigadores hicieron una revisión histórica de los regímenes de no proliferación que fueron creados para controlar tecnologías emergentes anteriores, como la nuclear.

Solo que ella representa un emprendimiento tecnológico y material tan complejo y costoso que se ha mantenido, hasta ahora, bajo el control de gobiernos nacionales. Y de todas formas, proliferó.

La IA está en manos de empresas privadas… y cada vez son más.

¡Gracias por acompañarme hasta aquí!

La mayor parte del contenido de Mundo Abierto es de acceso libre para todo el mundo porque el objetivo principal es compartir la información y el análisis.

Esto solo es posible con el apoyo de los suscriptores de pago que sostienen el proyecto por una pequeña cantidad mensual.

Agradezco a quienes se han comprometido con una suscripción de pago, en particular al Patrocinio Destacado de:

💛💜 Ximena Santaolalla Abdó 💛💜

💛💜 José Luis Aguilar Carbajal 💛💜

💛💜 Martha Barbiaux 💛💜

La censura -el shadow banning o prohibición oculta- tiró el tráfico de mis cuentas de redes sociales, haciéndolo caer en 80 y hasta 90%, como expliqué aquí (además, lo reporteé más a fondo aquí).

Para combatir esta censura, te convoco a actuar.

Comparte. Recomienda. Comenta. Platica sobre lo que te interesó.

Sígueme en Instagram, X, Facebook, Tik Tok, YouTube, Threads, vía @temoris.

Suscríbete a Mundo Abierto gratis.

Y si está en tus posibilidades actuales, toma o regala una suscripción de pago.

Otras vías de pago o donaciones:

Transferencia (por favor, avísanos a ojosdeperromx@gmail.com):

Témoris Grecko Berumen Alegre

Banco BBVA (México)

Cuenta 1275656486

CLABE: 012 180 01275656486 4

Código SWIFT BCMRMXMMPYM

O vía Stripe (acepta tarjetas bancarias, Google Pay, Apple Pay y Oxxo)

(Para Stripe, puedes seguir este QR)

O vía Paypal (haz clic aquí paypal.me/temorisg )

Solo una sociedad que apoya a su periodismo goza de un periodismo que la sirve a ella ✊

Los otros periodismos sirven a quienes les pagan: poderes económicos, políticos, religiosos y otros…